1

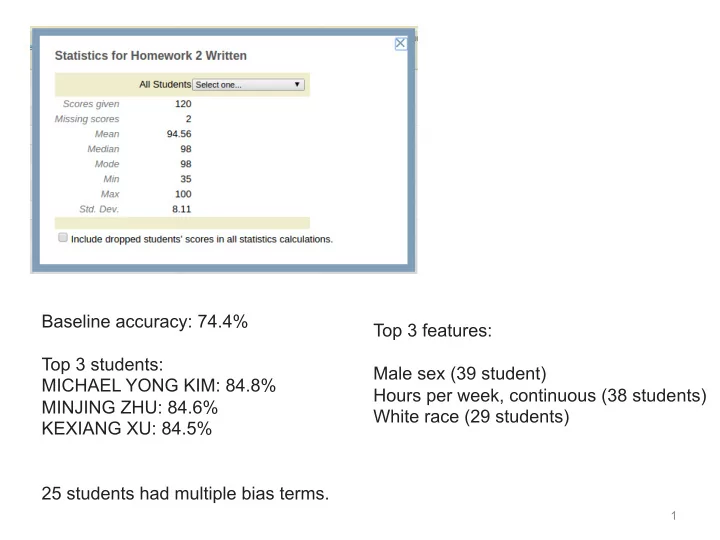

Baseline accuracy: 74.4% Top 3 students: MICHAEL YONG KIM: 84.8% MINJING ZHU: 84.6% KEXIANG XU: 84.5% 25 students had multiple bias terms. Top 3 features: Male sex (39 student) Hours per week, continuous (38 students) White race (29 students)

Baseline accuracy: 74.4% Top 3 features: Top 3 students: Male sex - - PowerPoint PPT Presentation

Baseline accuracy: 74.4% Top 3 features: Top 3 students: Male sex (39 student) MICHAEL YONG KIM: 84.8% Hours per week, continuous (38 students) MINJING ZHU: 84.6% White race (29 students) KEXIANG XU: 84.5% 25 students had multiple bias

1

Baseline accuracy: 74.4% Top 3 students: MICHAEL YONG KIM: 84.8% MINJING ZHU: 84.6% KEXIANG XU: 84.5% 25 students had multiple bias terms. Top 3 features: Male sex (39 student) Hours per week, continuous (38 students) White race (29 students)

3

4

7

8

decision tree learning algorithm; very similar to version in earlier slides

shades of blue/red indicate strength of vote for particular classification

13

time = 0 blue/red = class size of dot = weight weak learner = Decision stub: horizontal or vertical l

14

time = 1

this hypothesis has 15% error and so does this ensemble, since the ensemble contains just this one hypothesis

15

time = 2

16

time = 3

17

time = 13

18

time = 100

19

time = 300

“heavier” ¡data ¡points ¡

– e.g., ¡MLE ¡for ¡Naïve ¡Bayes, ¡redefine ¡Count(Y=y) ¡to ¡be ¡weighted ¡count: ¡ – sebng ¡D(j)=1 ¡(or ¡any ¡constant ¡value!), ¡for ¡all ¡j, ¡will ¡recreates ¡ unweighted ¡case ¡

n j=1

How? Many possibilities. Will see one shortly!

Why? Reweight the data: examples i that are misclassified will have higher weights!

Dt+1(i) < Dt(i) ¡

Dt+1(i) > Dt(i)

Final Result: linear sum of “base” or “weak” classifier

D1(i) = 1/m, for i = 1, . . . , m

m

X

i=1

Dt(i) exp(−αtyiht(xi))

H(x) = sign T X

i=1

αtht(x) !

D1(i) = 1/m, for i = 1, . . . , m

0.2 0.4 0.6 0.8 1.0 3 2 1 1 2

m)

m

i=1

¡ ¡ ¡ Where ¡ ¡ ¡ ¡ ¡ [Schapire, 1989]

m

i=1

m

i=1

¡ ¡ ¡ Where ¡ ¡ ¡ And ¡ ¡

¡ ¡ ¡

[Schapire, 1989] This equality isn’t

shown with algebra (telescoping sums)!

t

m

i=1

1 m

m

X

i=1

δ(H(xi) 6= yi) 1 m

m

X

i=1

Dt(i) exp(yif(xi))

¡ ¡ ¡ ¡ ¡ ¡ [Schapire, 1989]

m

i=1

m

i=1

✏t =

m

X

i=1

Dt(i)(ht(xi) 6= yi)

x1

Use ¡decision ¡stubs ¡as ¡base ¡classifier ¡ Ini7al: ¡

t=1: ¡

¡= ¡0.33×1+0.33×0+0.33×0=0.33 ¡

= ¡0.33×exp(-‑0.35×1×-‑1) ¡= ¡0.33×exp(0.35) ¡= ¡0.46 ¡

= ¡0.33×exp(-‑0.35×-‑1×-‑1) ¡= ¡0.33×exp(-‑0.35) ¡= ¡0.23 ¡

= ¡0.33×exp(-‑0.35×1×1) ¡= ¡0.33×exp(-‑0.35) ¡=0.23 ¡

t=2 ¡

¡ ¡ Ini7alize: ¡ For ¡t=1…T: ¡

¡

¡ Output ¡final ¡classifier: ¡ D1(i) = 1/m, for i = 1, . . . , m

Dt+1(i) ∝ Dt(i) exp(−αtyiht(xi))

H(x) = sign(0.35×h1(x))

H(x) = sign T X

i=1

αtht(x) !

✏t =

m

X

i=1

Dt(i)(ht(xi) 6= yi)

x1

t=2: ¡

new ¡data ¡weights ¡D; ¡breaking ¡7es ¡opportunis7cally ¡ (will ¡discuss ¡at ¡end)] ¡

¡= ¡0.5×0+0.25×1+0.25×0=0.25 ¡

= ¡0.5×exp(-‑0.55×1×1) ¡= ¡0.5×exp(-‑0.55) ¡= ¡0.29 ¡

= ¡0.25×exp(-‑0.55×-‑1×1) ¡= ¡0.25×exp(0.55) ¡= ¡0.43 ¡

= ¡0.25×exp(-‑0.55×1×1) ¡= ¡0.25×exp(-‑0.55) ¡= ¡0.14 ¡

t=3

¡ ¡

Ini7alize: ¡ For ¡t=1…T: ¡

¡

¡ Output ¡final ¡classifier: ¡ D1(i) = 1/m, for i = 1, . . . , m

Dt+1(i) ∝ Dt(i) exp(−αtyiht(xi))

H(x) = sign(0.35×h1(x)+0.55×h2(x))

H(x) = sign T X

i=1

αtht(x) !

✏t =

m

X

i=1

Dt(i)(ht(xi) 6= yi)

x1

t=3: ¡

because ¡of ¡new ¡data ¡weights ¡D; ¡breaking ¡7es ¡

¡= ¡0.33×0+0.5×0+0.17×1=0.17 ¡

¡ ¡ Ini7alize: ¡ For ¡t=1…T: ¡

¡

¡ Output ¡final ¡classifier: ¡ D1(i) = 1/m, for i = 1, . . . , m

H(x) = sign T X

i=1

αtht(x) !

Dt+1(i) ∝ Dt(i) exp(−αtyiht(xi))

H(x) = sign(0.35×h1(x)+0.55×h2(x)+0.79×h3(x))

m

i=1

t

T

t=1

[Schapire, 1989]

Test error Training error

[Freund & Schapire, 1996]

[Freund & Schapire, 1996]

[Freund & Schapire, 1996] error error error

w0, ¡w1, ¡… ¡wn ¡via ¡gradient ¡

m

X

i=1

ln(1 + exp(−yif(xi)))

m

i=1