Managed by UT-Battelle for the Department of Energy

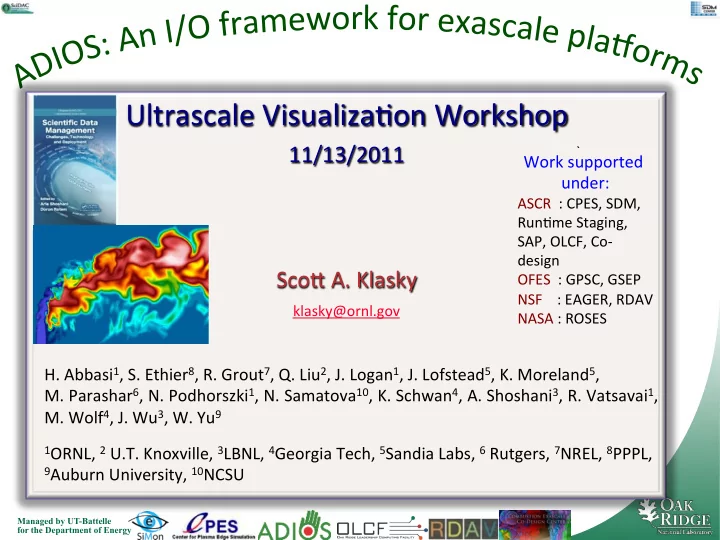

Ultrascale ¡Visualiza.on ¡Workshop ¡

11/13/2011 ¡

¡ ¡

Sco; ¡A. ¡Klasky ¡

klasky@ornl.gov ¡

- H. ¡Abbasi1, ¡S. ¡Ethier8, ¡R. ¡Grout7, ¡Q. ¡Liu2, ¡J. ¡Logan1, ¡J. ¡Lofstead5, ¡K. ¡Moreland5, ¡

- M. ¡Parashar6, ¡N. ¡Podhorszki1, ¡N. ¡Samatova10, ¡K. ¡Schwan4, ¡A. ¡Shoshani3, ¡R. ¡Vatsavai1,

¡

- M. ¡Wolf4, ¡J. ¡Wu3, ¡W. ¡Yu9 ¡

¡ 1ORNL, ¡2 ¡U.T. ¡Knoxville, ¡3LBNL, ¡4Georgia ¡Tech, ¡5Sandia ¡Labs, ¡6 ¡Rutgers, ¡7NREL, ¡8PPPL, ¡ 9Auburn ¡University, ¡10NCSU ¡

Work ¡supported ¡ under: ¡

ASCR ¡ ¡: ¡CPES, ¡SDM, ¡ Run.me ¡Staging, ¡ SAP, ¡OLCF, ¡Co-‑ design ¡ OFES ¡ ¡: ¡GPSC, ¡GSEP ¡ NSF ¡ ¡ ¡ ¡: ¡EAGER, ¡RDAV ¡ NASA ¡: ¡ROSES ¡